GIS steht für Geoinformationssystem: eine Kombination aus Geodaten, Datenbanken und Analysewerkzeugen. Damit erfassen, analysieren und kartografisch visualisieren Fachanwender räumliche Informationen.

Die GIS-basierte Flächensuche ist in vielen Projekten ein entscheidender Zeitfaktor und spielt in sehr unterschiedlichen Kontexten eine Rolle, von Infrastruktur- und Gewerbeentwicklungen bis hin zu Umwelt- und Fachplanungen. Eine automatisierte, datengetriebene Flächenanalyse kann hier ansetzen: Sie identifiziert in kurzer Zeit Kandidatenflächen, schließt offensichtlich ungeeignete Bereiche aus und beschleunigt die Vorprüfung deutlich.

Der praktische Vorteil liegt darin, große Untersuchungsräume systematisch und reproduzierbar vorzuselektieren. Statt Karten manuell zu durchsuchen, entstehen priorisierte Kandidatenflächen mit dokumentierten Kriterien, Datenständen und Parametern.

Vorgehen im Überblick

Kernidee: Für ein definiertes Untersuchungsgebiet (AOI), ein PLZ-Gebiet, einen Landkreis oder ein Bundesland verarbeitet die Pipeline alle Höhenmodell-Kacheln, die dieses Gebiet schneiden (siehe Datenbasis). Die Kachel ist die Verarbeitungseinheit, und die Pipeline läuft automatisiert über die vollständige Kachelmenge des AOI.

Technisch besteht die Flächensuche aus einer Kette gut nachvollziehbarer Verarbeitungsschritte: Die Pipeline liest Höhenmodelle ein, berechnet topografische Kenngrößen, kombiniert Eignungs- und Ausschlussmasken und gibt die verbleibenden Bereiche als Polygone aus. Methodisch ist das zugleich ein gutes Beispiel dafür, wie Mathematik, Numerik und Geometrie in praktische Entscheidungsprozesse einfließen.

Häufig liegt das digitale Geländemodell als Rasterdatensatz vor, zum Beispiel als GeoTIFF-Datei. Daraus leitet die Analyse topografische Kenngrößen numerisch ab, mit Finite-Differenzen-Approximationen für lokale Ableitungen und mit Interpolation für konsistente Werteübergänge. Daneben existieren Höhenmodelle, die direkt auf Punktwolken basieren, wie bei LiDAR-Aufnahmen. In solchen Fällen spielen Triangulierungen, insbesondere Delaunay-Triangulationen, eine zentrale Rolle. Dieses Konzept ist auch aus FEM sowie aus verwandten Verfahren wie Box- bzw. Finite-Volumen-Methoden gut bekannt. Im nächsten Schritt entsteht die eigentliche Flächenabgrenzung. Dabei fasst der Prozess geeignete Bereiche zu zusammenhängenden Regionen zusammen und bereitet sie als Polygone auf. Methoden der algorithmischen Geometrie sind dafür bei Komponentenbildung, Verschneidung, Bereinigung und Vereinfachung zentral.

Damit diese Kette auch bei großen Gebieten funktioniert, ist Skalierung entscheidend. Für die Vektordaten hat sich GeoPackage (GPKG) als robustes Arbeitsformat bewährt, denn ein räumlicher Index (R-Tree) beschleunigt Filter und Überlagerungen auch bei großen Layern deutlich. PostGIS kann als Staging-Schicht für performante Overlay- und Distanzoperationen dienen. Dadurch leitet die Pipeline Kandidatenflächen effizient ab, bewertet sie und exportiert sie für nachgelagerte GIS-Workflows.

Datenbasis

Kurz zu den wichtigsten Begriffen: Die AOI (Area of Interest) bezeichnet das Untersuchungsgebiet. DEM (Digital Elevation Model) verwenden wir hier als Sammelbegriff für kachelweise bereitgestellte Höhenmodelle. GPKG beziehungsweise GeoPackage ist ein robustes GIS-Dateiformat für Vektor- und Rasterdaten.

Für die Höhenmodelle ist die Unterscheidung wichtig: Ein digitales Geländemodell (DGM) beschreibt die Bodenhöhe ohne Gebäude und Vegetation, ein digitales Oberflächenmodell (DOM/DSM) enthält zusätzlich Bebauung und Bewuchs.

Das Vorgehen stützt sich auf zwei zentrale Datenquellen.

- Höhendaten als Raster (GeoTIFF) und je nach Datenangebot auch als Punktwolke (z. B. LiDAR). Typischerweise liegen DEM-Kacheln als 1 km × 1 km bei 1 m Auflösung vor, z. B. in EPSG:25832. Aus den Höhendaten lassen sich topografische Kenngrößen ableiten, die für die Flächenbewertung zentral sind.

- Vektordaten für Ausschlussmasken aus OpenStreetMap (OSM), z. B. Wasserflächen und Wald. Diese Informationen dienen als Ausschlusskriterien; optional ergänzen vorhandene WFS-Layer (z. B. regionale Fachportale) die Datenbasis.

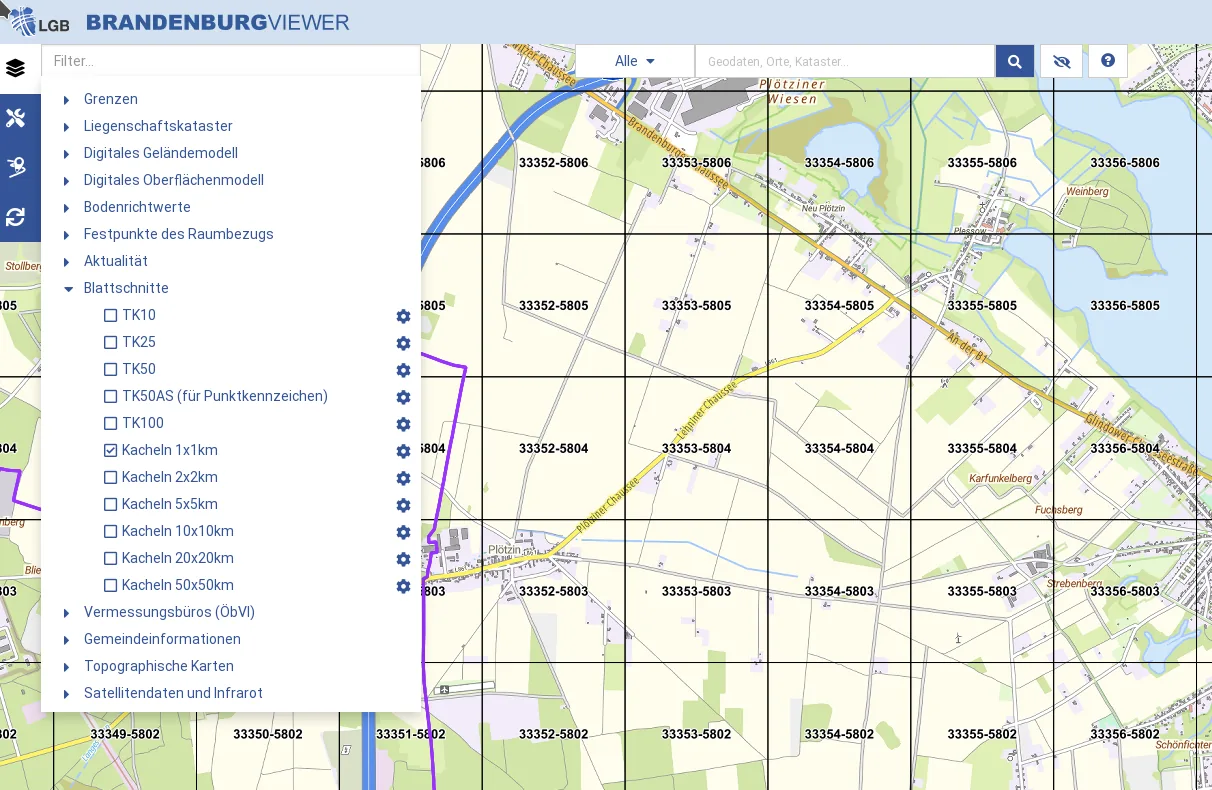

Die offenen Geobasis-Portale der Bundesländer liefern die Datenbasis. Eine landesspezifische JSON-Konfiguration beschreibt Einstiegspunkte und Download-Parameter, weil Struktur, Metadaten und Zugriffswege je Bundesland variieren. Ein Python-Downloader liest die Konfigurationen, lädt die DEM-Kacheln und legt sie in einer konsistenten Projektstruktur ab. Optional schreibt er ein Manifest (Datenstand, Parameter, heruntergeladene Dateien) und protokolliert Vollständigkeits- und Integritätsprüfungen (z. B. Dateigröße/Hash). Bei temporären Netzwerkproblemen startet der Downloader Wiederholversuche (Retries).

Die Kachelstruktur vereinfacht den Download und beschleunigt die spätere Verarbeitung. Kachelbasierte Workflows skalieren gut, und räumliche Indexstrukturen wie Quadtrees helfen, Teilgebiete gezielt nachzuladen und Ergebnisse konsistent über Kachelgrenzen hinweg zusammenzuführen.

Exemplarisch lässt sich das Vorgehen an Brandenburg erläutern: Der Python-Downloader lädt DEM‑Kacheln automatisiert aus dem GeoBasis‑BB‑Verzeichnis herunter. Bei einer Fläche von rund 30.000 km² fallen bei 1 km × 1 km‑Kacheln ungefähr 30.000 Kacheln an.

Vereinfacht sieht die Kernlogik im Downloader dann so aus:

def download_tile(tile, output_dir, force):

target = output_dir / tile.name

if target.exists() and not force:

return

with urllib.request.urlopen(tile.url) as response, open(target, "wb") as handle:

shutil.copyfileobj(response, handle)

for tile in filtered:

download_tile(tile, args.output, args.force)Als grobe Analogie auf der Kommandozeile entspricht das:

for tile in 33250-5888 33250-5889; do

curl -L -o "dgm_${tile}.zip" "https://data.geobasis-bb.de/geobasis/daten/dgm/xyz/dgm_${tile}.zip"

doneWorkflow in 4 Schritten

Die folgenden vier Schritte zeigen, wie aus den Eingangsdaten prüfbare Flächenvorschläge entstehen. Die Methodik ist bewusst allgemein gehalten und lässt sich auf unterschiedliche Planungs- und Prüfkontexte übertragen.

1) Ableitungen aus dem Digitalen Geländemodell

Welche Kenngrößen tatsächlich zum Einsatz kommen, hängt vom Anwendungsfall ab. Im Folgenden dienen Steigung und Südausrichtung nur als Beispiel, weil sie leicht zu interpretieren sind und sich gut zur Illustration der Maskenbildung eignen.

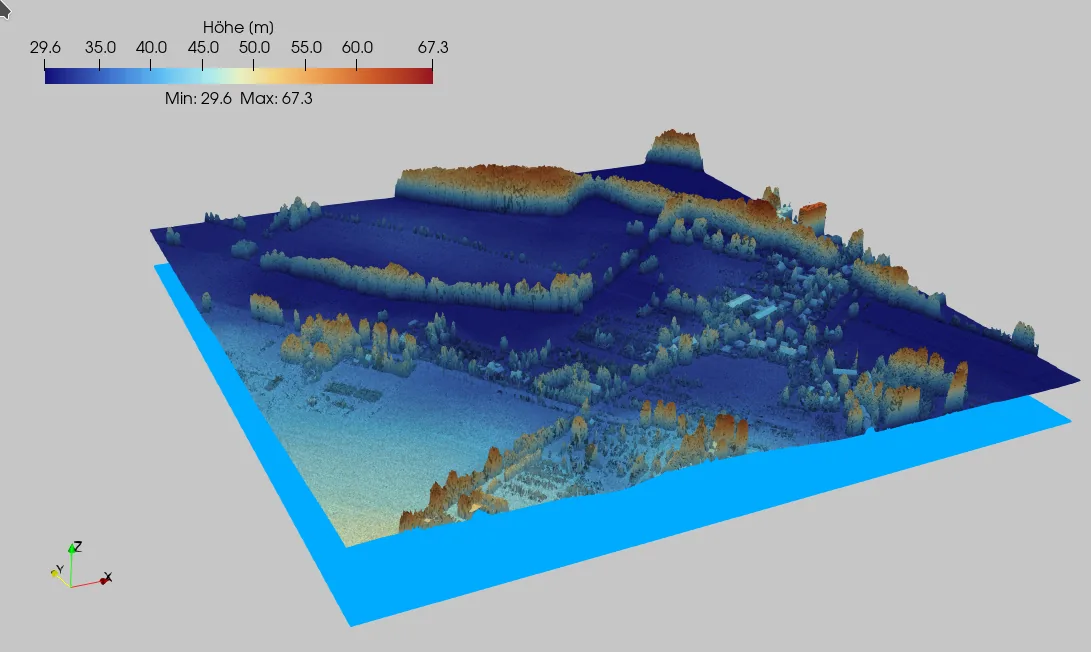

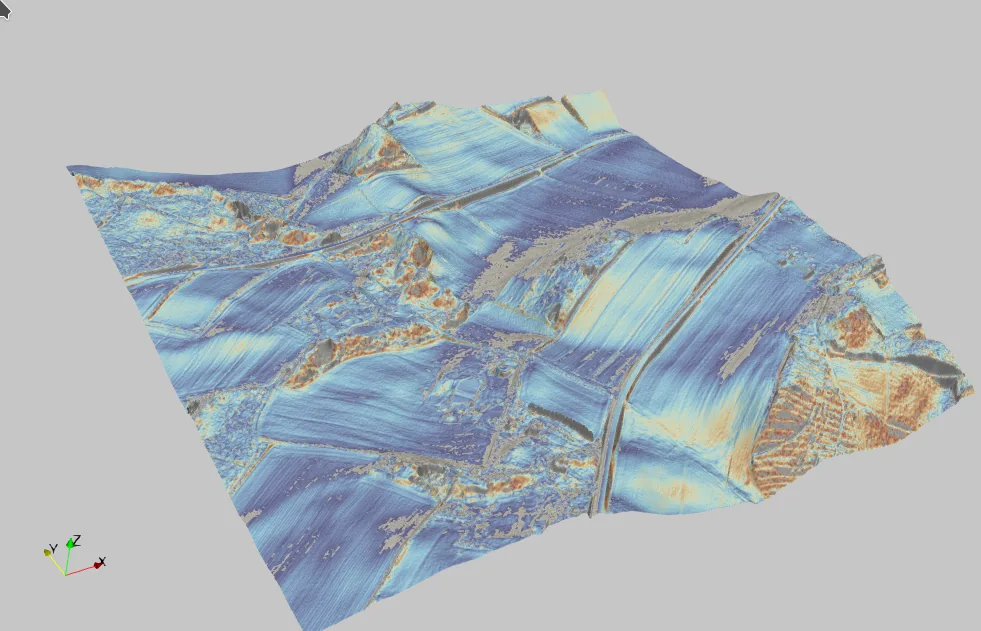

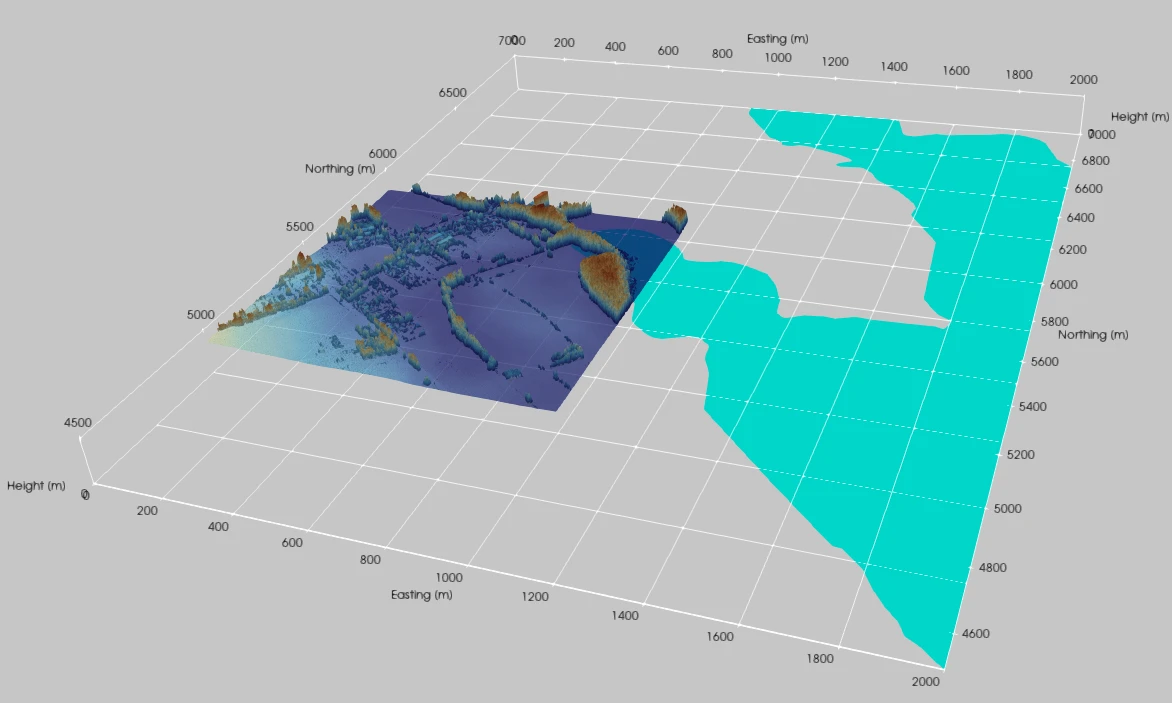

Je nach Bundesland liefern die Geodatenportale das Digitale Geländemodell in unterschiedlichen Formaten. In Brandenburg stellen sie die Daten auch als XYZ-Punktwolken bereit. Der Konverter rasterisiert diese Punktwolken in ein einheitliches GeoTIFF (typisch 1 m Auflösung). Optional erzeugt der Prozess zusätzlich ein ParaView-kompatibles Format für die 3D-Visualisierung. Anschließend berechnet das System aus dem Raster Kenngrößen wie Neigung, Rauigkeit und Südausrichtung.

entstehen Masken für die Kachel.

Maske.

Vereinfacht lassen sich die beiden Beispielkriterien so formulieren:

-

Ebene Fläche (kleine Hangneigung):

\[ \qquad \qquad

\lVert \nabla h \rVert < \varepsilon \] -

Südausrichtung (passende Exposition):

\[ \qquad \qquad

\left\langle \frac{-\nabla h}{\lVert \nabla h \rVert}, \mathbf{e}_{\mathrm{south}} \right\rangle > \mathrm{tol}

\qquad \textsf{ (Variante Gradient)}

\]\[ \qquad \qquad

\mathbf{n} = (-\partial_x h,\,-\partial_y h,\,1), \qquad

\left\langle \frac{\mathbf{n}}{\lVert \mathbf{n} \rVert}, \mathbf{e}_{\mathrm{south,3D}} \right\rangle >

\mathrm{tol}

\qquad \textsf{(Variante Flächennormale)}

\]

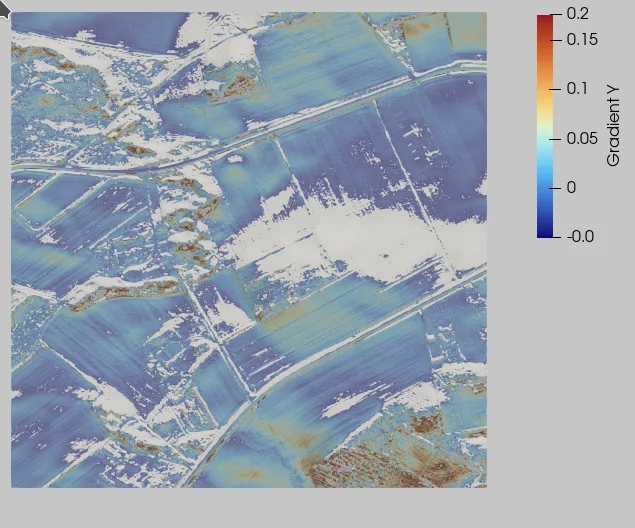

Dabei bezeichnet \(h(x,y)\) das Höhenfeld (Geländehöhe) über der \(xy\)-Ebene und \( \nabla h = (\partial_x h,\partial_y h) \) den lokalen Steigungsvektor (Gradienten). Der Betrag \( \|\nabla h\| \) ist ein Maß für die Hangneigung, und \( \varepsilon \) ist der zugehörige Schwellwert. Für die Südausrichtung gibt es zwei äquivalente Sichtweisen: Über die Richtung der stärksten Abnahme (mit \(-\nabla h\)) oder über die Flächennormale \( \mathbf{n} \). In beiden Fällen vergleicht das Verfahren die lokale Richtung mit einer Zielrichtung (z. B. Süden). Das Skalarprodukt prüft anschließend, ob die lokale Richtung ausreichend gut zur Zielrichtung passt. Die Schwelle \(\mathrm{tol}\) steuert, wie streng diese Ausrichtung gefordert wird.

2) Ausschlussmasken anwenden

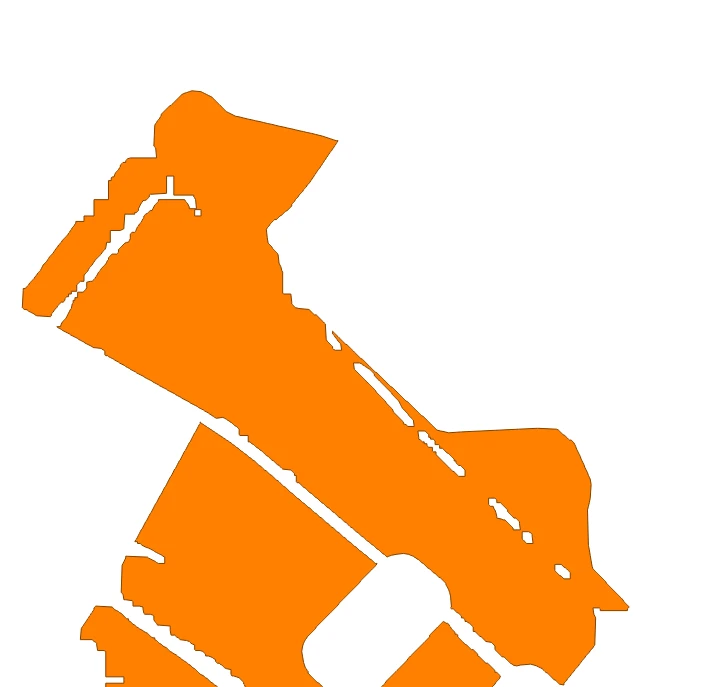

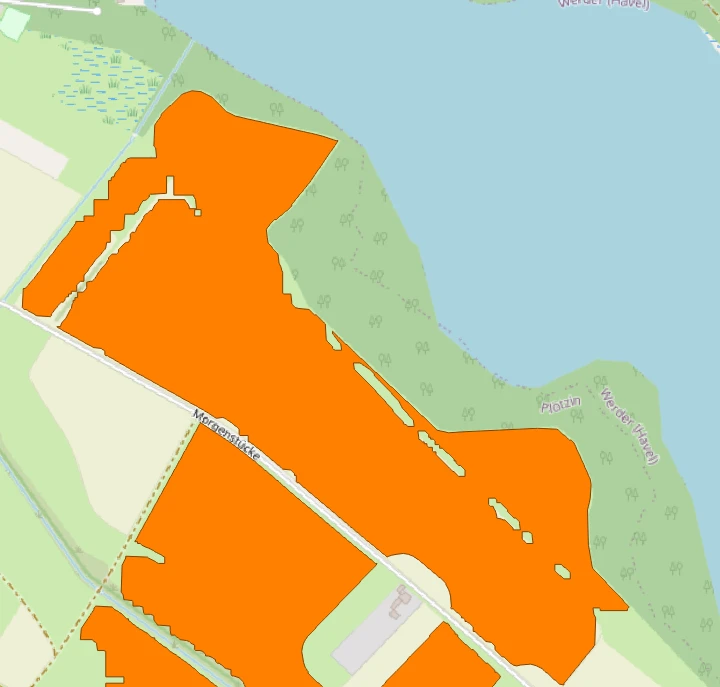

Aus den abgeleiteten Kenngrößen bildet das System eine Eignungsmaske, typischerweise über Schwellwerte für geringe Neigung (hinreichend ebene Bereiche) und eine gewünschte Exposition wie Südausrichtung. Morphologische Operationen wie Opening und Closing glätten bei Bedarf kleine Löcher, Ausreißer und Rauschen. Anschließend überlagert das System die Maske mit Ausschluss- und Konfliktdaten, etwa mit OSM-Wasserflächen oder Wald, sodass diese Bereiche aus der Kandidatenmaske herausfallen. Im Bild zeigt sich das am Beispiel einer Wasserfläche, die das Verfahren von der DEM-Kachel abzieht; dadurch bleiben nur die verbleibenden Landbereiche als Kandidaten übrig. Zusätzlich lassen sich Fachlayer über WFS (Web Feature Service) einbinden, also online bereitgestellte Vektordaten wie Schutzgebiete oder planungsrechtliche Layer.

Praktisch nutzt die Pipeline dafür eine AOI-Bounding-Box und den R-Tree-Index in GeoPackage (GPKG). Damit schränkt sie einen Ausschlusslayer früh räumlich ein, sodass nur AOI-Treffer in die Überlagerung eingehen. Bei GeoJSON ist das in der Regel deutlich teurer, weil Programme große Dateien häufig vollständig einlesen und Feature für Feature prüfen müssen. In einem Testlauf sank die Laufzeit für die Ausschlüsse von 344,6 s auf 0,18 s. Das entspricht einem Speed-up von fast 2.000×, weil statt 1.077.114 OSM-Straßen-Features nur 303 AOI-Treffer in die Verarbeitung gingen (Bounding-Box-Filter plus R-Tree). Die Gesamtlaufzeit ging dabei von 352,4 s auf 7,9 s zurück (≈ 45×). Das Ergebnis blieb praktisch identisch.

3) Bildung zusammenhängender Flächen

Das System wertet die kombinierte Maske komponentenbasiert aus (4-/8-Konnektivität), wandelt sie in Polygone um und filtert sie anschließend. Typische Filter sind Mindestfläche und Kompaktheit. Bei hoher Geometriekomplexität vereinfacht zum Beispiel der Douglas-Peucker-Algorithmus die Polygonränder. So bleiben zusammenhängende, planerisch relevante Flächen übrig, die als Kandidaten weiter in die Bewertung eingehen.

4) Scoring und Priorisierung

Für jede Polygonfläche berechnet das System Kennwerte, zum Beispiel Fläche, Statistiken zu Neigung und Rauigkeit sowie Konfliktflags. Daraus bildet es ein nachvollziehbares Scoring, das eine priorisierte Kandidatenliste ermöglicht. Zudem dokumentiert und versioniert es Gewichtungen und Parameter, sodass Ergebnisse und Rangfolgen reproduzierbar bleiben.

Ergebnisse & Outputs

Ein Python-Programm erzeugt alle Ableitungen, Masken, Polygonisierungen und Bewertungen. Die Ausschlussmasken basieren auf OpenStreetMap-Daten, die ein PBF-Extrakt für Brandenburg liefert und die Skripte anschließend automatisiert in thematische Layer überführen, insbesondere Wasserflächen und -linien, Wald, Feuchtgebiete, Wohngebiete sowie Straßen und Wege. Quelle (Geofabrik): brandenburg-latest.osm.pbf. Die Extraktion läuft skriptgesteuert mit GDAL/ogr2ogr und Makefile-Targets.

Die folgenden Ansichten zeigen die resultierenden Layer in QGIS.

Die Outputs lassen sich unmittelbar in gängigen GIS-Werkzeugen nutzen und weiterverarbeiten, besonders in QGIS:

- Kandidatenflächen als Polygonlayer im GeoPackage-Format (GPKG) für die Projektablage. Optional zusätzlich als

GeoJSON für Austausch und Web-Workflows. - Attributtabelle beziehungsweise Topliste als CSV mit den relevanten Bewertungsmerkmalen

- Run-Dokumentation mit AOI, Datenständen, Parametern und Zeitstempel

Damit liegen sowohl eine Karte zur visuellen Prüfung als auch strukturierte Tabellen für Filterung und Priorisierung vor. Die Ergebnisse lassen sich projektübergreifend vergleichen und unabhängig vom konkreten Anwendungsfall in bestehende GIS-Workflows integrieren.

Perspektivisch ergänzt eine leichte, interaktive UI die Auswertung, etwa auf Basis von Plotly. Denkbar sind Ranking-Ansichten, Filter und Drill-down, Karten-Overlays sowie Parametervergleiche zwischen Runs. So lassen sich Kandidaten auch ohne vollständiges GIS-Setup schnell sichten, während die GIS-Exports weiterhin die maßgeblichen Ergebnisse liefern.

Fazit und Ausblick

Die GIS-basierte Flächensuche lässt sich als durchgängige Pipeline aufsetzen: DGM/DOM einlesen und aufbereiten, daraus Kenngrößen ableiten, Eignungs- und Ausschlussmasken kombinieren, zusammenhängende Bereiche zu Polygonen aggregieren und anschließend filtern und bewerten. So entstehen Kandidatenflächen, die sich in Standard-GIS-Werkzeugen direkt prüfen und weiterbearbeiten lassen. Kachelbasierte Verarbeitung, nachvollziehbare Parameter und saubere Exporte helfen dabei, die Ergebnisse konsistent zu halten und Varianten strukturiert gegenüberzustellen.

Für die nächsten Ausbaustufen bieten sich einige pragmatische Erweiterungen an. PLZ- oder Gemeindepolygone machen die AOI-Auswahl deutlich komfortabler (alle Kacheln, die den Bereich schneiden); alternativ beschreibt eine Gemeinde plus Radius R das Suchgebiet (alle Kacheln im Umkreis von R km). Zusätzlich können Infrastrukturdatensätze wie Stromnetz-Leitungen und Umspannwerke einfließen. Daraus leitet das System Kennwerte wie die Distanz zum nächsten Netzanschlusspunkt ab und nutzt sie in Filter oder Scoring. Ebenso relevant sind verkehrliche Kriterien, z. B. die Nähe zu Autobahnanschlüssen oder gut ausgebauten Zuwegungen, um Erreichbarkeit und Logistik bereits in der Vorprüfung zu berücksichtigen.

Wenn Sie große Untersuchungsgebiete eingrenzen, vorhandene Geodaten auswerten oder erste Bewertungskriterien strukturiert anwenden möchten, freue ich mich über Ihre Anfrage. Gern prüfe ich, ob und wie sich ein GIS-gestützter Ansatz für Ihre Flächensuche eignet. Kontakt aufnehmen.

Hinweis: Der Beitrag entstand mit Unterstützung von ChatGPT. Inhaltliche Prüfung, Auswahl und Redaktion liegen beim

Autor.